Nâng cao chất lượng ảnh màu mặt người bởi SVD của DCT trong miền logarit ứng dụng trong hệ thống nhận dạng mặt người

TÓM TẮT

Trong bài báo này, chúng tôi đưa ra một phương pháp cân bằng ánh sáng

hữu hiệu để nâng cao chất lượng ảnh mặt người trong không gian màu RGB ứng

dụng trong nhận dạng mặt người. Trước tiên, ảnh mặt người trong không gian

màu RGB được phân tách thành ba kênh màu và tham chiếu Gaussian được biến

đổi sang miền logarit. Sau đó sử dụng biến đổi Cosin rời rạc để xác định các thành

phần tần số thấp mang thông tin độ sáng của ảnh mặt người. Các hệ số bù sáng

tương ứng với ba kênh màu RGB sẽ được tính toán một cách tự động thông qua tỉ

lệ các giá trị riêng lớn nhất của các ma trận hệ số biến đổi Cosin rời rạc, tần số

thấp của ba kênh màu và tham chiếu Gaussian. Kết quả thử nghiệm trên hai bộ

cơ sở dữ liệu màu nổi tiếng CMU-PIE và FERET cho thấy, ảnh khuôn mặt người thu

được không chỉ rõ hơn, lấy lại được màu da người tự nhiên, ứng dụng rất nhiều

trong lĩnh vực thị giác máy tính, mà còn nâng cao được hiệu suất của hệ thống

nhận dạng mặt người, tốt hơn các phương pháp hiện nay như ASVD và TSVD.

Trang 1

Trang 2

Trang 3

Trang 4

Trang 5

Trang 6

Trang 7

Trang 8

Tóm tắt nội dung tài liệu: Nâng cao chất lượng ảnh màu mặt người bởi SVD của DCT trong miền logarit ứng dụng trong hệ thống nhận dạng mặt người

có:

{DCT_R��, DCT_G��, DCT_B��} = DCT(R��, G��, B��) (9)

DCT_Ga�� = DCT(Ga��) (10)

Như thảo luận trong phần 2.3, giá trị riêng của ảnh chứa

thông tin độ sáng và giá trị riêng lớn nhất chứa 99,72%

năng lượng của ảnh, do đó tính toán SVD của DCT_RLT

DCT_G��, DCT_B�� và DCT_Ga��:

DCT_R�� = U� ∗ Σ� ∗ V�

�; (11)

DCT_G�� = U� ∗ Σ� ∗ V�

�; (12)

DCT_B�� = U� ∗ Σ� ∗ V�

�; (13)

DCT_Ga�� = U�� ∗ Σ�� ∗ (14)

Ký hiệu các giá trị riêng lớn nhất của Σ�, Σ� , Σ� và Σ��

tương ứng là λ�, λ� , λ� và λ�� . Khi đó, hệ số bù sáng cho các

kênh màu được tính như sau:

μ� =

���

��

(15)

μ� =

���

��

(16)

μ� =

���

��

(17)

(a)

CÔNG NGHỆ

Tạp chí KHOA HỌC & CÔNG NGHỆ ● Số 54.2019 24

KHOA HỌC P-ISSN 1859-3585 E-ISSN 2615-9619

(b)

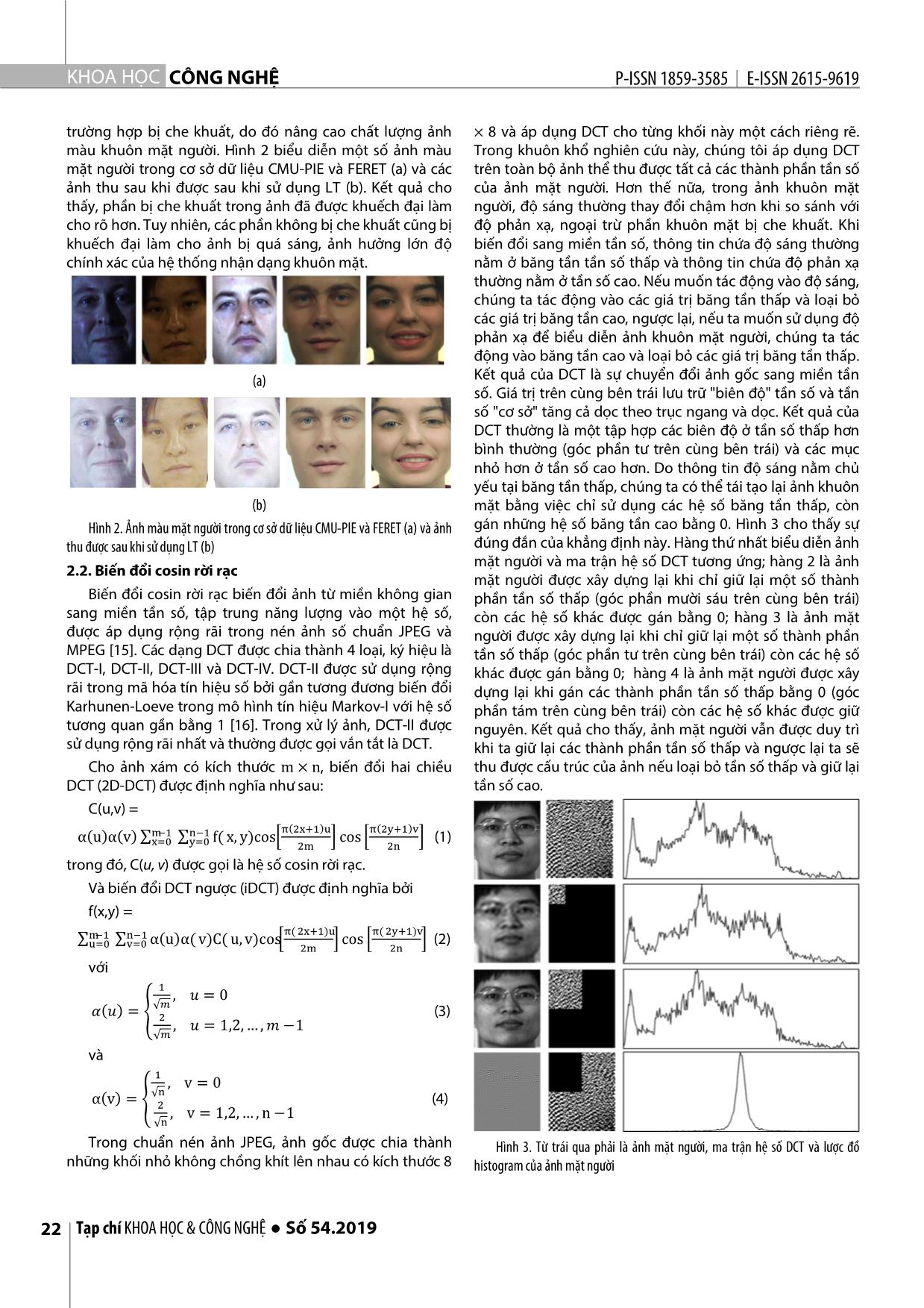

Hình 6. Ảnh màu mặt người và lược đồ histogram của nó (a); ảnh ALDS của

ảnh gốc ở hàng trên và lược đồ histogram của ALDS (b)

Thông qua các hệ số bù sáng này, cách hệ số DCT được

tính toán lại bằng cách nhân với hệ số bù sáng như sau:

DCT_R�ù = U� ∗ (μ�Σ�) ∗ V�

�; (18)

DCT_G�ù = U� ∗ (μ� Σ� ) ∗ V�

�; (19)

DCT_B�ù = U� ∗ (μ�Σ�) ∗ V�

�; (20)

Sử dụng biến đổi DCT ngược của các hệ số DCT bù sáng,

ta được các kênh màu sau khi bù sáng:

R�ù = iDCT(DCT_R�ù); (21)

G�ù = iDCT(DCT_G�ù); (22)

B�ù = iDCT(DCT_B�ù); (23)

Cuối cùng, trộn lẫn ba kênh màu và chuẩn hóa dữ liệu,

ta thu được ảnh màu mặt người, ký hiệu là ALDS, không chỉ

rõ nét hơn rất nhiều so với ảnh gốc, mà còn tái tạo lại được

mầu da người, có thể rất hữu hiệu trong lĩnh vực thị giác

máy tính và phát hiện màu da, như chỉ trong hình 6. Do bề

mặt người không phải là bề mặt khuếch tán hoàn hảo (bề

mặt lambertian) nên trong một số trường hợp, có những

đặc trưng của khuôn mặt không nằm ở băng tần thấp. Hơn

nữa, những phần bị che khuất cũng nằm trên cùng băng

tần với các đặc trưng quan trọng của khuôn mặt, do đó có

lúc độ sáng sẽ không được bù đúng bởi bỏ đi các tần số

cao. Do vậy, trong nghiên cứu này, chúng tôi không dùng

biến đổi logarit ngược. Hình 6 cho ta thấy, ảnh màu mặt

người ALDS rõ nét hơn, màu da đúng với tự nhiên hơn và

có phân bố giá trị độ sáng gần với phân bố chuẩn chính

tắc. Do vậy, nâng cao được hiệu suất của hệ thống nhận

dạng khuôn mặt người.

4. KẾT QUẢ THỰC NGHIỆM

Để làm rõ sự hiệu quả của phương pháp ALDS, chúng

tôi tiến hành thực nghiệm trên hai cơ sở dữ liệu ảnh màu

nổi tiếng là CMU-PIE [19] và FERET [20]. Chúng tôi cũng so

sánh kết quả của ALDS với các phương pháp trước như

ASVD, TSVD và ảnh màu mặt người thu được bằng việc chỉ

sử dụng LT, ký hiệu là CFLT, như thảo luận trong phần 2.1.

Để tiến hành so sánh, chúng tôi sử dụng các phương pháp

trích xuất đặc trưng khuôn mặt để tiến hành nhận dạng

khác nhau như Eigenface [21] và LBP [22].

4.1. Thực nghiệm trên cơ sở dữ liệu CMU-PIE

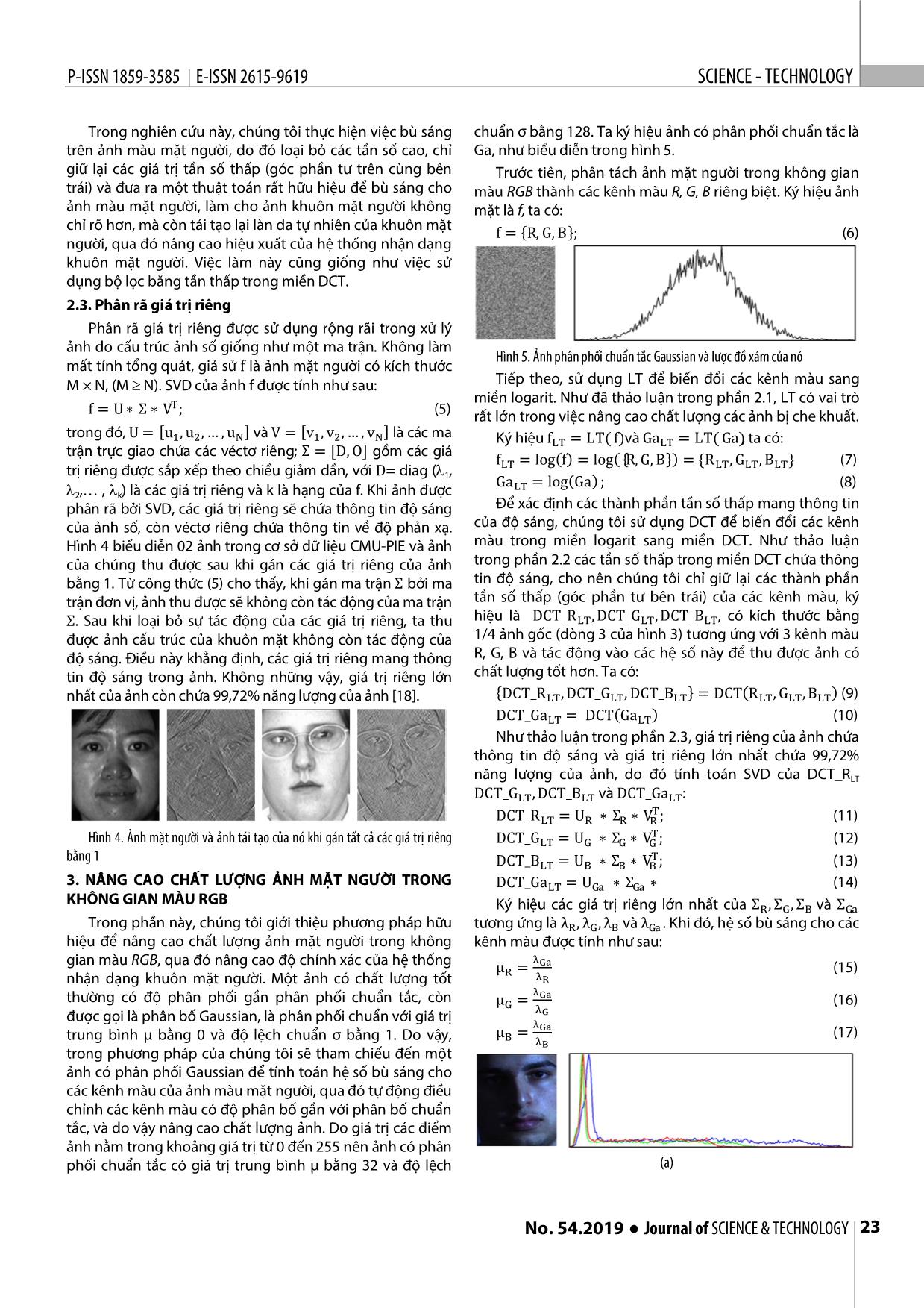

Cơ sở dữ liệu mặt người CMU-PIE bao gồm 41.368 bức

ảnh màu của 68 người. Mỗi người được chụp dưới 13 tư

thế, 43 cường độ sáng, 4 sắc thái khuôn mặt khác nhau. Để

thực nghiệm kết quả, mỗi người lấy 45 ảnh chụp trực diện,

mỗi ảnh có độ sáng khác nhau được chụp bởi máy ảnh

trung tâm (c27), bao gồm hai điều kiện "tắt đèn" và "bật

đèn". Loại "tắt đèn" bao gồm 21 độ sáng từ f02 đến f22,

trong khi loại "bật đèn" bao gồm 24 độ sáng từ f00 đến f23

như trong hình 7(a). Khuôn mặt người được trích xuất và

chuẩn hóa dưới cùng một kích thước 96×132. Tổng cộng

chúng tôi có 3600 ảnh. Chúng tôi sử dụng lần lượt từng

phương pháp ASVD, TSVD, CFLT và ALDS để thu được các

ảnh từ ảnh màu mặt người gốc để tiến hành nhận dạng.

Hình 7 biểu diễn các ảnh gốc và kết quả của của các

phương pháp. Hình 7(a) biểu diễn 45 ảnh dưới 45 độ sáng

khác nhau, trong cả điều kiện “tắt đèn” và “bật đèn” của

một người trong cơ sở dữ liệu CMU-PIE. Hình 7(b) biểu diễn

kết quả thu được sau khi áp dụng phương pháp ASVD và

kết quả của phương pháp TSVD được biểu diễn trong hình

7(b). Kết quả cho thấy, ảnh sau khi được nâng cao không

quá khác biệt so với ảnh gốc vì các phương pháp này xử lý

ảnh trong miền không gian. Hình 7(c) biểu diễn ảnh thu

được khi áp dụng phương pháp CFLT như thảo luận trong

mục 2.1. Kết quả cho thấy, ảnh đã rõ nét hơn nhưng chúng

ta vẫn thấy được tác động của điều kiện “tắt đèn” và “bật

đèn”. Kết của phương pháp ALDS của chúng tôi được biểu

diễn trong hình 7(d). Kết quả cho thấy, tất cả các ảnh đã rõ

nét hơn, đặc biệt là các ảnh bị che khuất và tái tạo được làn

da gốc của người, trông rất tự nhiên. Tất cả các ảnh có màu

sắc giống nhau như được chụp cùng một thời điểm trong

điều kiện “bật đèn”.

(a)

(b)

P-ISSN 1859-3585 E-ISSN 2615-9619 SCIENCE - TECHNOLOGY

No. 54.2019 ● Journal of SCIENCE & TECHNOLOGY 25

(c)

(d)

(e)

Hình 7. (a) 45 ảnh gốc của một người trong cơ sở dữ liệu CMU-PIE; (b) ASVD

của (a); (c) TSVD của (a); (d) CFLT của (a); (e) ALDS của (a)

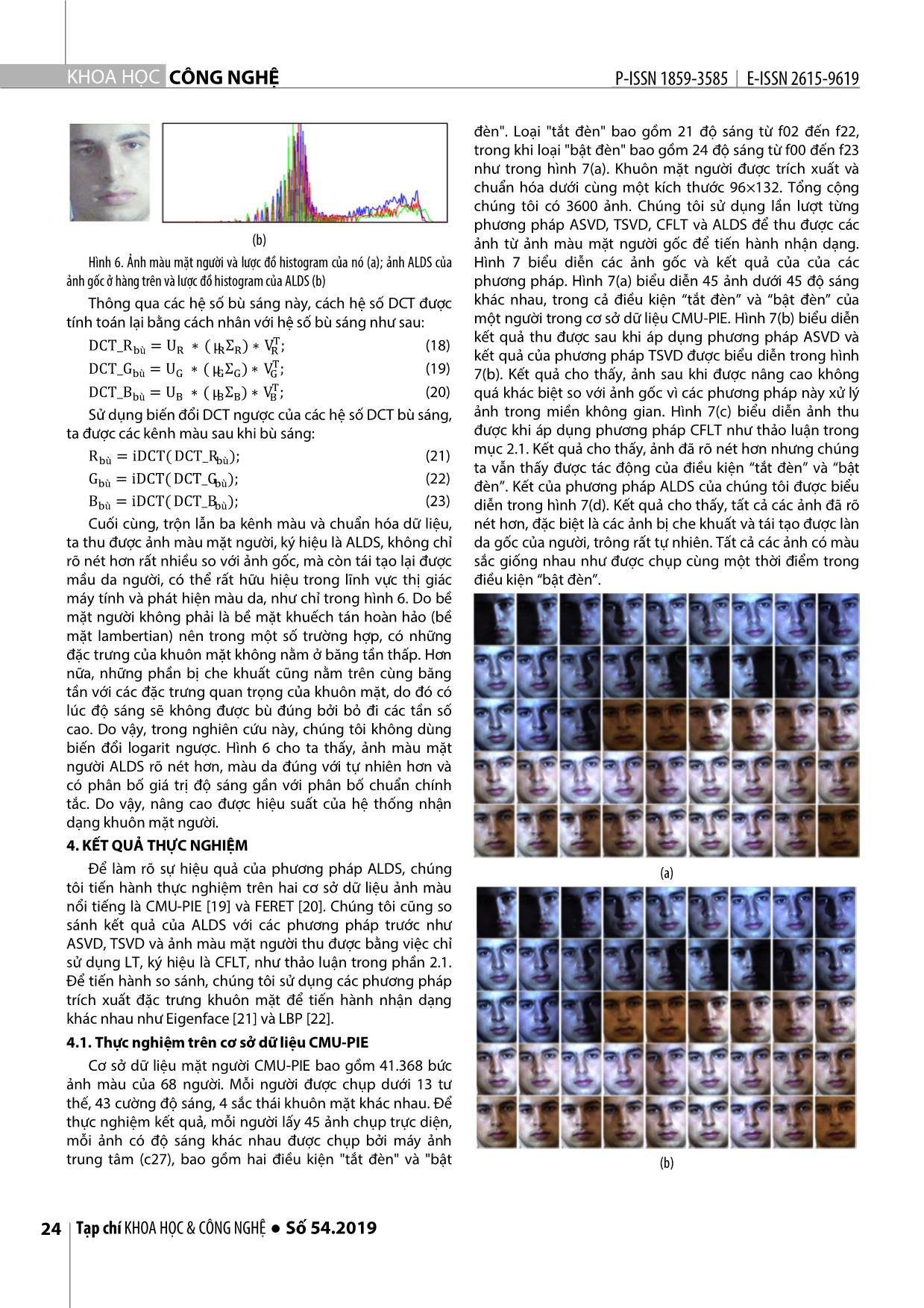

Bảng 1. Kết quả nhận dạng mặt người trên cơ sở dữ liệu CMU-PIE bằng

phương pháp eigenface

Số

thành phần

Tỉ lệ nhận dạng

Ảnh gốc ASVD TSVD CFLT ALDS

10 58,77 63,82 60,39 63,33 74,12

20 75,54 78,73 78,14 80,54 87,60

30 81,13 83,24 83,14 85,15 91,57

40 83,38 85,34 85,25 87,11 93,73

50 84,85 86,91 86,57 88,33 94,80

60 86,13 87,75 87,84 89,22 95,20

70 87,06 88,48 88,58 89,80 95,64

80 87,30 89,07 88,82 90,00 95,98

90 87,79 89,41 89,22 90,20 96,37

100 88,19 89,66 89,51 90,25 96,52

110 88,63 90,00 90,05 90,44 96,72

120 88,82 90,15 90,34 90,69 96,81

Tất cả 90,05 91,22 91,43 92,42 98,14

Hình 8. Tỉ lệ nhận dạng bằng phương pháp eigenface trên cơ sở dữ liệu

CMU-PIE

Đầu tiên, chúng tôi sử dụng phương pháp eigenface để

đánh giá hiệu suất của nhận dạng khuôn mặt. Phương

pháp eigenface dựa trên việc ánh xạ tuyến tính ảnh mặt

người vào không gian đặc trưng có số chiều thấp hơn bằng

cách sử dụng phương pháp phân tích thành phần chính

(PCA). Nó sử dụng các thành phần chính là các véc-tơ riêng

tương ứng với các giá trị riêng lớn nhất làm đặc trưng và

sau đó dùng giải thuật hàng xóm lân cận nhất giữa ảnh

huấn luyện và ảnh kiểm tra. Để tiến hành nhận dạng, với

mỗi người trong cơ sở dữ liệu, chúng tôi chọn 15 ảnh để

huấn luyện và 30 ảnh còn lại để kiểm tra. Kết quả nhận

dạng được biểu diễn trong bảng 1 và hình 8. Kết quả cho

thấy, phương pháp ALDS đã nâng cao đáng kể tỉ lệ nhân

dạng mặt người, cao hơn ảnh gốc, ASVD, TSVD, CFLT lần

lượt là 8,09%, 6,42%, 6,71% và 5,72%.

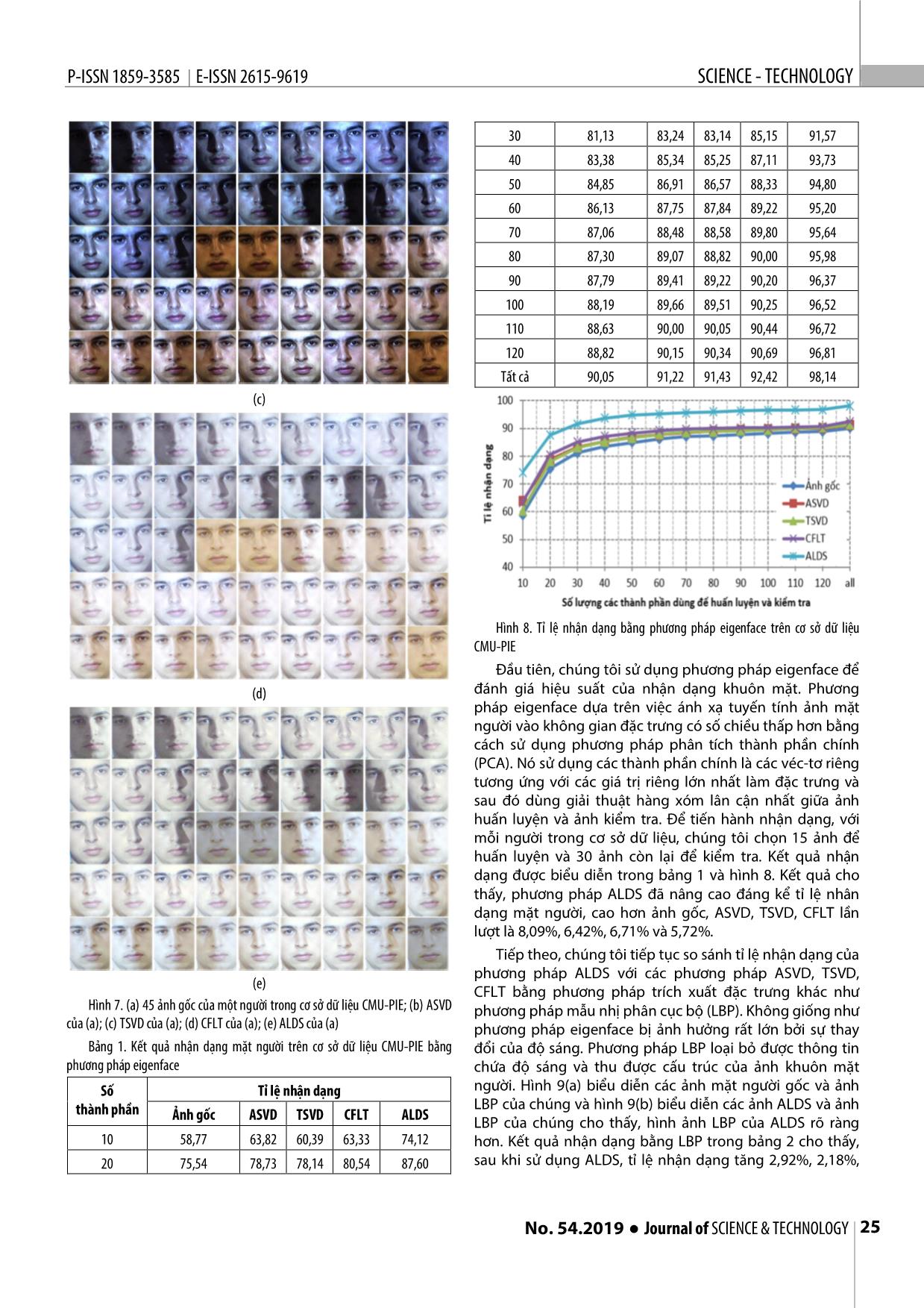

Tiếp theo, chúng tôi tiếp tục so sánh tỉ lệ nhận dạng của

phương pháp ALDS với các phương pháp ASVD, TSVD,

CFLT bằng phương pháp trích xuất đặc trưng khác như

phương pháp mẫu nhị phân cục bộ (LBP). Không giống như

phương pháp eigenface bị ảnh hưởng rất lớn bởi sự thay

đổi của độ sáng. Phương pháp LBP loại bỏ được thông tin

chứa độ sáng và thu được cấu trúc của ảnh khuôn mặt

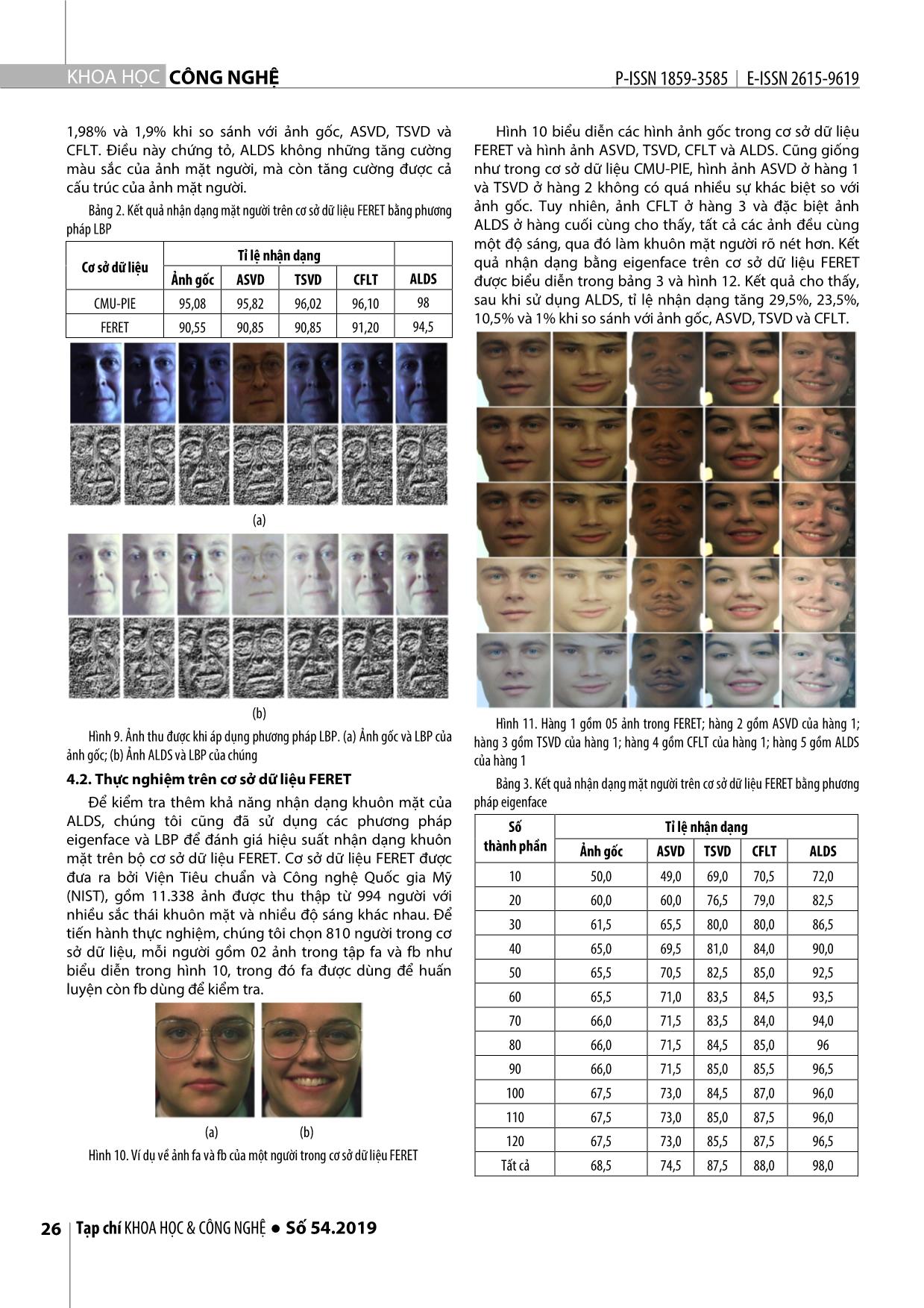

người. Hình 9(a) biểu diễn các ảnh mặt người gốc và ảnh

LBP của chúng và hình 9(b) biểu diễn các ảnh ALDS và ảnh

LBP của chúng cho thấy, hình ảnh LBP của ALDS rõ ràng

hơn. Kết quả nhận dạng bằng LBP trong bảng 2 cho thấy,

sau khi sử dụng ALDS, tỉ lệ nhận dạng tăng 2,92%, 2,18%,

CÔNG NGHỆ

Tạp chí KHOA HỌC & CÔNG NGHỆ ● Số 54.2019 26

KHOA HỌC P-ISSN 1859-3585 E-ISSN 2615-9619

1,98% và 1,9% khi so sánh với ảnh gốc, ASVD, TSVD và

CFLT. Điều này chứng tỏ, ALDS không những tăng cường

màu sắc của ảnh mặt người, mà còn tăng cường được cả

cấu trúc của ảnh mặt người.

Bảng 2. Kết quả nhận dạng mặt người trên cơ sở dữ liệu FERET bằng phương

pháp LBP

Cơ sở dữ liệu

Tỉ lệ nhận dạng

Ảnh gốc ASVD TSVD CFLT ALDS

CMU-PIE 95,08 95,82 96,02 96,10 98

FERET 90,55 90,85 90,85 91,20 94,5

(a)

(b)

Hình 9. Ảnh thu được khi áp dụng phương pháp LBP. (a) Ảnh gốc và LBP của

ảnh gốc; (b) Ảnh ALDS và LBP của chúng

4.2. Thực nghiệm trên cơ sở dữ liệu FERET

Để kiểm tra thêm khả năng nhận dạng khuôn mặt của

ALDS, chúng tôi cũng đã sử dụng các phương pháp

eigenface và LBP để đánh giá hiệu suất nhận dạng khuôn

mặt trên bộ cơ sở dữ liệu FERET. Cơ sở dữ liệu FERET được

đưa ra bởi Viện Tiêu chuẩn và Công nghệ Quốc gia Mỹ

(NIST), gồm 11.338 ảnh được thu thập từ 994 người với

nhiều sắc thái khuôn mặt và nhiều độ sáng khác nhau. Để

tiến hành thực nghiệm, chúng tôi chọn 810 người trong cơ

sở dữ liệu, mỗi người gồm 02 ảnh trong tập fa và fb như

biểu diễn trong hình 10, trong đó fa được dùng để huấn

luyện còn fb dùng để kiểm tra.

(a) (b)

Hình 10. Ví dụ về ảnh fa và fb của một người trong cơ sở dữ liệu FERET

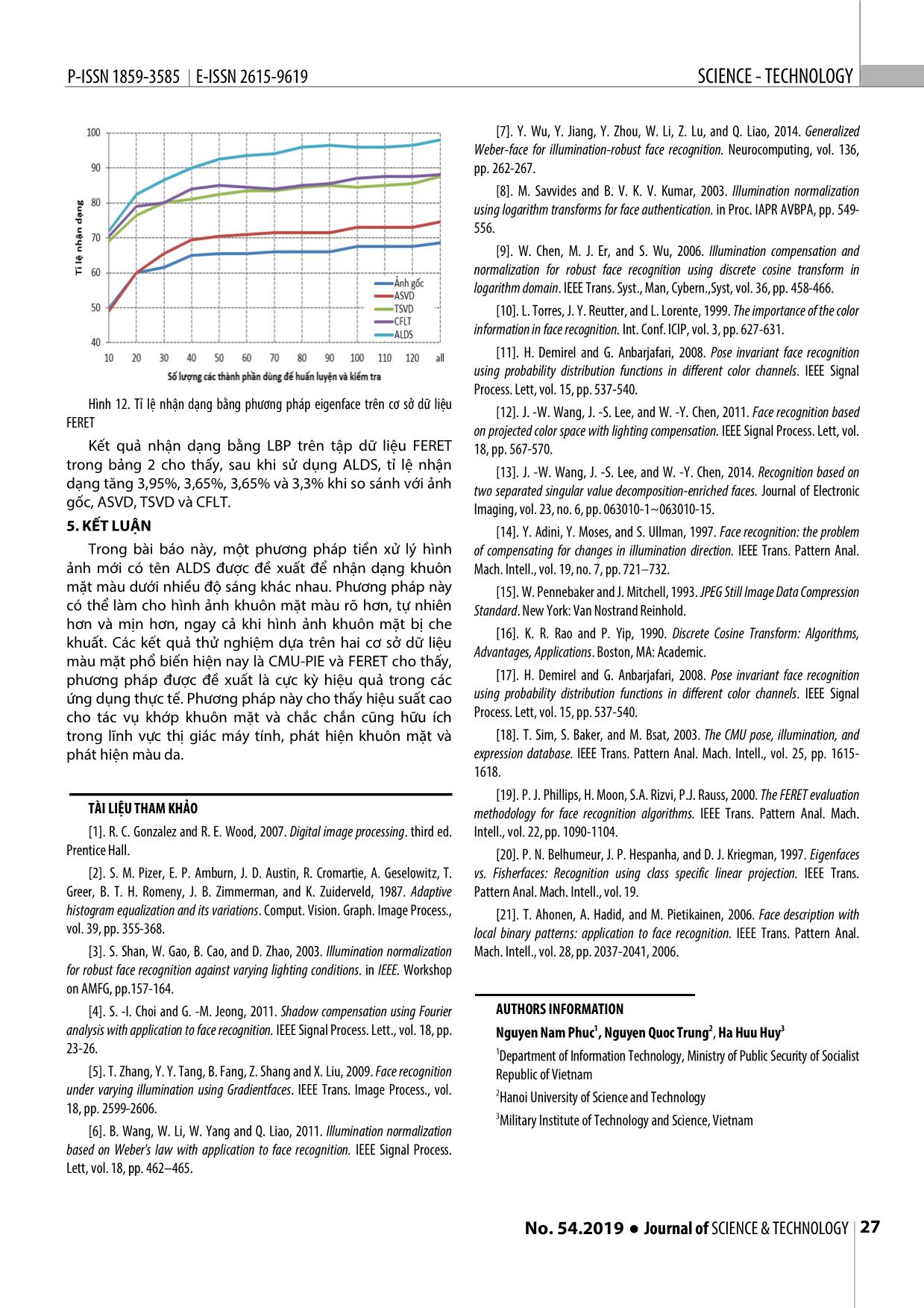

Hình 10 biểu diễn các hình ảnh gốc trong cơ sở dữ liệu

FERET và hình ảnh ASVD, TSVD, CFLT và ALDS. Cũng giống

như trong cơ sở dữ liệu CMU-PIE, hình ảnh ASVD ở hàng 1

và TSVD ở hàng 2 không có quá nhiều sự khác biệt so với

ảnh gốc. Tuy nhiên, ảnh CFLT ở hàng 3 và đặc biệt ảnh

ALDS ở hàng cuối cùng cho thấy, tất cả các ảnh đều cùng

một độ sáng, qua đó làm khuôn mặt người rõ nét hơn. Kết

quả nhận dạng bằng eigenface trên cơ sở dữ liệu FERET

được biểu diễn trong bảng 3 và hình 12. Kết quả cho thấy,

sau khi sử dụng ALDS, tỉ lệ nhận dạng tăng 29,5%, 23,5%,

10,5% và 1% khi so sánh với ảnh gốc, ASVD, TSVD và CFLT.

Hình 11. Hàng 1 gồm 05 ảnh trong FERET; hàng 2 gồm ASVD của hàng 1;

hàng 3 gồm TSVD của hàng 1; hàng 4 gồm CFLT của hàng 1; hàng 5 gồm ALDS

của hàng 1

Bảng 3. Kết quả nhận dạng mặt người trên cơ sở dữ liệu FERET bằng phương

pháp eigenface

Số

thành phần

Tỉ lệ nhận dạng

Ảnh gốc ASVD TSVD CFLT ALDS

10 50,0 49,0 69,0 70,5 72,0

20 60,0 60,0 76,5 79,0 82,5

30 61,5 65,5 80,0 80,0 86,5

40 65,0 69,5 81,0 84,0 90,0

50 65,5 70,5 82,5 85,0 92,5

60 65,5 71,0 83,5 84,5 93,5

70 66,0 71,5 83,5 84,0 94,0

80 66,0 71,5 84,5 85,0 96

90 66,0 71,5 85,0 85,5 96,5

100 67,5 73,0 84,5 87,0 96,0

110 67,5 73,0 85,0 87,5 96,0

120 67,5 73,0 85,5 87,5 96,5

Tất cả 68,5 74,5 87,5 88,0 98,0

P-ISSN 1859-3585 E-ISSN 2615-9619 SCIENCE - TECHNOLOGY

No. 54.2019 ● Journal of SCIENCE & TECHNOLOGY 27

Hình 12. Tỉ lệ nhận dạng bằng phương pháp eigenface trên cơ sở dữ liệu

FERET

Kết quả nhận dạng bằng LBP trên tập dữ liệu FERET

trong bảng 2 cho thấy, sau khi sử dụng ALDS, tỉ lệ nhận

dạng tăng 3,95%, 3,65%, 3,65% và 3,3% khi so sánh với ảnh

gốc, ASVD, TSVD và CFLT.

5. KẾT LUẬN

Trong bài báo này, một phương pháp tiền xử lý hình

ảnh mới có tên ALDS được đề xuất để nhận dạng khuôn

mặt màu dưới nhiều độ sáng khác nhau. Phương pháp này

có thể làm cho hình ảnh khuôn mặt màu rõ hơn, tự nhiên

hơn và mịn hơn, ngay cả khi hình ảnh khuôn mặt bị che

khuất. Các kết quả thử nghiệm dựa trên hai cơ sở dữ liệu

màu mặt phổ biến hiện nay là CMU-PIE và FERET cho thấy,

phương pháp được đề xuất là cực kỳ hiệu quả trong các

ứng dụng thực tế. Phương pháp này cho thấy hiệu suất cao

cho tác vụ khớp khuôn mặt và chắc chắn cũng hữu ích

trong lĩnh vực thị giác máy tính, phát hiện khuôn mặt và

phát hiện màu da.

TÀI LIỆU THAM KHẢO

[1]. R. C. Gonzalez and R. E. Wood, 2007. Digital image processing. third ed.

Prentice Hall.

[2]. S. M. Pizer, E. P. Amburn, J. D. Austin, R. Cromartie, A. Geselowitz, T.

Greer, B. T. H. Romeny, J. B. Zimmerman, and K. Zuiderveld, 1987. Adaptive

histogram equalization and its variations. Comput. Vision. Graph. Image Process.,

vol. 39, pp. 355-368.

[3]. S. Shan, W. Gao, B. Cao, and D. Zhao, 2003. Illumination normalization

for robust face recognition against varying lighting conditions. in IEEE. Workshop

on AMFG, pp.157-164.

[4]. S. -I. Choi and G. -M. Jeong, 2011. Shadow compensation using Fourier

analysis with application to face recognition. IEEE Signal Process. Lett., vol. 18, pp.

23-26.

[5]. T. Zhang, Y. Y. Tang, B. Fang, Z. Shang and X. Liu, 2009. Face recognition

under varying illumination using Gradientfaces. IEEE Trans. Image Process., vol.

18, pp. 2599-2606.

[6]. B. Wang, W. Li, W. Yang and Q. Liao, 2011. Illumination normalization

based on Weber's law with application to face recognition. IEEE Signal Process.

Lett, vol. 18, pp. 462–465.

[7]. Y. Wu, Y. Jiang, Y. Zhou, W. Li, Z. Lu, and Q. Liao, 2014. Generalized

Weber-face for illumination-robust face recognition. Neurocomputing, vol. 136,

pp. 262-267.

[8]. M. Savvides and B. V. K. V. Kumar, 2003. Illumination normalization

using logarithm transforms for face authentication. in Proc. IAPR AVBPA, pp. 549-

556.

[9]. W. Chen, M. J. Er, and S. Wu, 2006. Illumination compensation and

normalization for robust face recognition using discrete cosine transform in

logarithm domain. IEEE Trans. Syst., Man, Cybern.,Syst, vol. 36, pp. 458-466.

[10]. L. Torres, J. Y. Reutter, and L. Lorente, 1999. The importance of the color

information in face recognition. Int. Conf. ICIP, vol. 3, pp. 627-631.

[11]. H. Demirel and G. Anbarjafari, 2008. Pose invariant face recognition

using probability distribution functions in different color channels. IEEE Signal

Process. Lett, vol. 15, pp. 537-540.

[12]. J. -W. Wang, J. -S. Lee, and W. -Y. Chen, 2011. Face recognition based

on projected color space with lighting compensation. IEEE Signal Process. Lett, vol.

18, pp. 567-570.

[13]. J. -W. Wang, J. -S. Lee, and W. -Y. Chen, 2014. Recognition based on

two separated singular value decomposition-enriched faces. Journal of Electronic

Imaging, vol. 23, no. 6, pp. 063010-1~063010-15.

[14]. Y. Adini, Y. Moses, and S. Ullman, 1997. Face recognition: the problem

of compensating for changes in illumination direction. IEEE Trans. Pattern Anal.

Mach. Intell., vol. 19, no. 7, pp. 721–732.

[15]. W. Pennebaker and J. Mitchell, 1993. JPEG Still Image Data Compression

Standard. New York: Van Nostrand Reinhold.

[16]. K. R. Rao and P. Yip, 1990. Discrete Cosine Transform: Algorithms,

Advantages, Applications. Boston, MA: Academic.

[17]. H. Demirel and G. Anbarjafari, 2008. Pose invariant face recognition

using probability distribution functions in different color channels. IEEE Signal

Process. Lett, vol. 15, pp. 537-540.

[18]. T. Sim, S. Baker, and M. Bsat, 2003. The CMU pose, illumination, and

expression database. IEEE Trans. Pattern Anal. Mach. Intell., vol. 25, pp. 1615-

1618.

[19]. P. J. Phillips, H. Moon, S.A. Rizvi, P.J. Rauss, 2000. The FERET evaluation

methodology for face recognition algorithms. IEEE Trans. Pattern Anal. Mach.

Intell., vol. 22, pp. 1090-1104.

[20]. P. N. Belhumeur, J. P. Hespanha, and D. J. Kriegman, 1997. Eigenfaces

vs. Fisherfaces: Recognition using class specific linear projection. IEEE Trans.

Pattern Anal. Mach. Intell., vol. 19.

[21]. T. Ahonen, A. Hadid, and M. Pietikainen, 2006. Face description with

local binary patterns: application to face recognition. IEEE Trans. Pattern Anal.

Mach. Intell., vol. 28, pp. 2037-2041, 2006.

AUTHORS INFORMATION

Nguyen Nam Phuc1, Nguyen Quoc Trung2, Ha Huu Huy3

1Department of Information Technology, Ministry of Public Security of Socialist

Republic of Vietnam

2Hanoi University of Science and Technology

3Military Institute of Technology and Science, Vietnam

File đính kèm:

nang_cao_chat_luong_anh_mau_mat_nguoi_boi_svd_cua_dct_trong.pdf

nang_cao_chat_luong_anh_mau_mat_nguoi_boi_svd_cua_dct_trong.pdf